>>1566952 @monkey

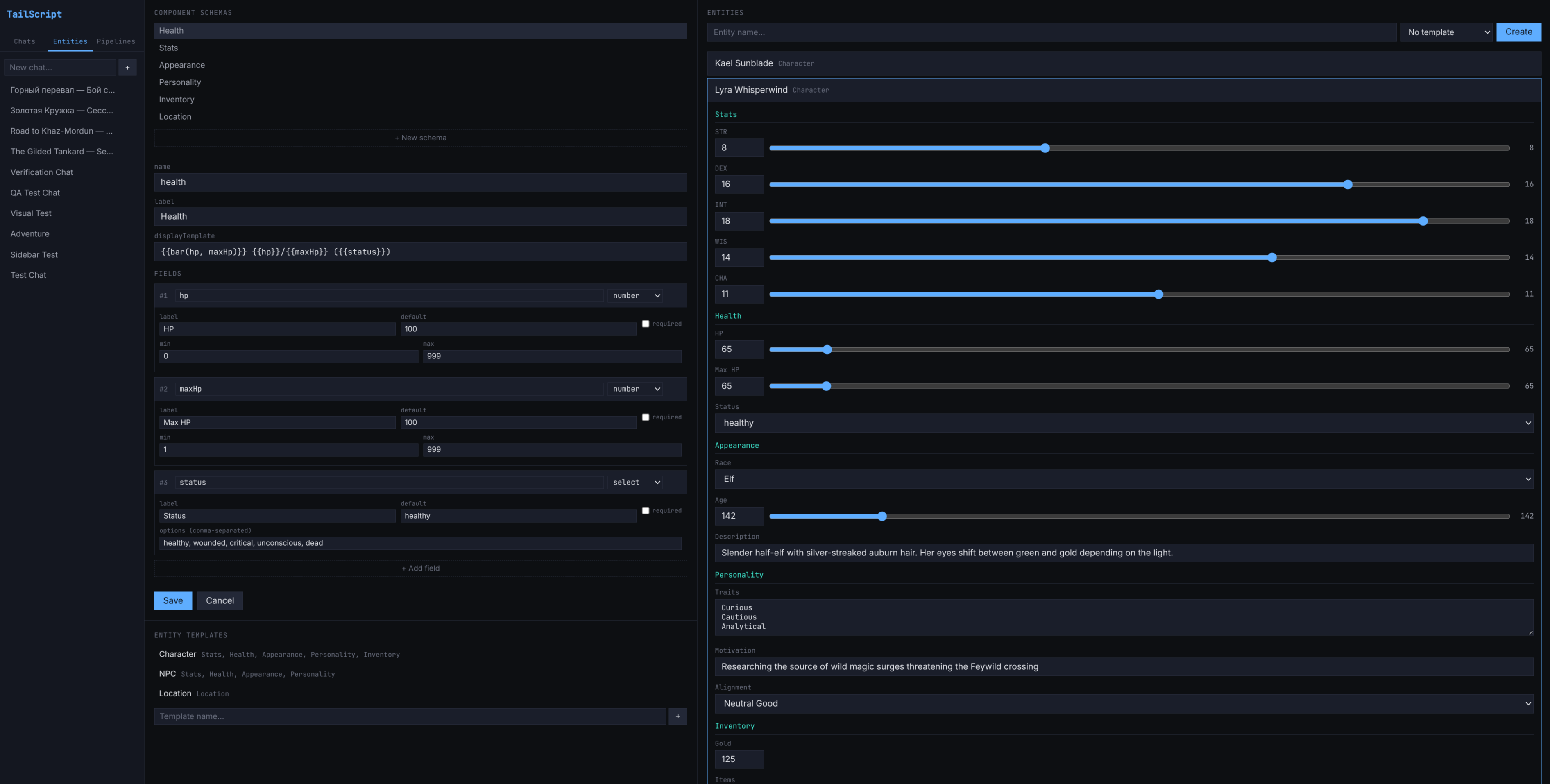

на 20гб 3090/4090 с exllama v2 70b q4_k_m влезает если контекст до 4к и без фруфру, но скорость как у черепахи. для 8к+ или q5 - только с тензорпараллелем на двухкартах или подкачка в рам, а винда жрёт да. линукс серверный режим + koboldcpp с --gpulayers all --contextsize 8192 и моделью q3_k_m - база для тестов, если терпения хватит 1-2т/с. вики в шапке глянь по offload.

>>1568190 @monkey

Для кода сейчас топ deepseek-coder-v2-lite-instruct 16b в gguf q4_k_m или q5_k_m, жрёт ~10гб vram, понимает контекст на уровне 128k, решает задачи лучше чем старые codellama. Качай с hf под exllama v2/v3 в tabbyapi или oobabooga, промпт типа "You are a senior dev, write clean python code for..." и temp 0.2-0.4.

Если 7b не потянуло, не лезь в мелочь - qwen2.5-coder-7b-instruct тоже ок для простого, но для суть задач бери 32b версию, она на 20-30% точнее по lm-arena. Тесты в шапке по лидербордам, там свежак 2026. С koboldcpp или st с stepped-thinking пресетом вывозит дебаг и рефакторинг без галлюцинаций.

Миксы типа a1401-code-mix от тредовичков на hf тоже годные для рп с кодом, но чистый deepseek стабильнее.